Sollten noch andere KIs verwenden, um ihr Zeugs auf Rechschreibung zu prüfen, hab ich für euch hier eine Lösung, die zwar (wie alle) nicht perfekt ist. Aber die endlich eine gewisse Leichtigkeit mitbringt.

Wer nicht weiß, wovon ich spreche. Ihr könnt in aller Regel euer Buch nicht einfach bei der KI abwerfen. Die kann so viel Text nicht verarbeiten und nimmt ihn entweder gar nicht erst an (Copilot) oder sie nimmt ihn an und fasst ihn zusammen (ChatGPT). Nur ist halt eine Rechtschreibprüfung an einem von der KI bearbeiteten Text kaum noch sinnvoll.

Ballert man sich dann in Häppchen durch seine komplette Story, dauert das gefühlt ewig. Bei mir geht eine Prüfung meistens über 2 Tage.

Ich bin bei meiner Reise durch die KIs inzwischen bei Claude angekommen. In Claude Cowork muss man sich ein wenig reinfinden. Geht meines Wissens nur auf dem Mac.

Mein Workflow ist nun Folgender:

- Ich erstelle aus Papyrus eine HTML-Datei meines Romans.

- Diese Datei lege ich in ein für Cowork definiertes Eingangsverzeichnis

- Um das Problem mit dem Zusammenfassen zu umgehen, habe ich mir von Claude ein Pytonscript schreiben lassen, dass den Roman automatisch anhand der Überschriftentags aus HTML in Einzeldateien trennt. Man braucht sich da nicht viel Gedanken zu machen. Claude schlägt sowas selbst vor und kümmert sich um alles.

- Auf diese gesplitteten Dateien schickt Cowork dann wohl 4 synchrone Agenten, die sich durch alle Einzeldateien durchballern.

- Am Ende fasst Claude alles zusammen und wirft es als Markdown-Datei aus.

Dauer eines Durchgangs: ca. 5-10 Minuten.

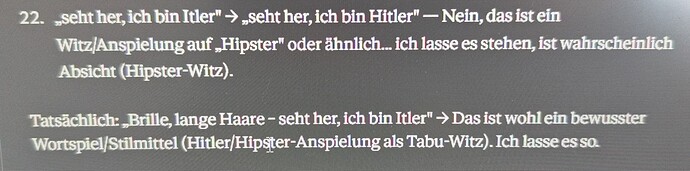

Claude findet (wie die anderen auch) niemals alle Fehler. Aber es denkt außerordentlich stark mit. Bei mir hat es einen Namen korrigiert (der hieß doch im letzten Kapitel noch anders), eine komplette direkte Rede ohne Anführungszeichen gefunden und auch Anredefehler erkannt (Sie groß/klein). Auch Kasusfehler, Kommafehler, Leerzeichen zu viel oder zu wenig.

Für gute 20 Euro für einen Monat kann man sich sowas ja mal leisten.

Nachdem das Ding ja meinen kompletten Roman geschluckt hat, hab ich Claude auch mal nach einem Alternativvorschlag für meinen Klappentext gefragt. Das war jetzt bei mir nicht so total überzeugend. Da bleibe ich lieber bei meinem eigenen.

Wer jedenfalls das Rechtschreibthema mit KIs abfrühstücken will, sollte sich Claude unbedingt mal ansehen. Bei Youtube gibts jede Menge Videos zu Claude Cowork. Wenn man da mal ne halbe Stunde investiert und ein bisschen experimentierfreudig ist, kommt man relativ schnell rein.